Praktyczne wskazówki na temat mikrotargetowania

Mikrotargetowanie jest procesem, który może przybliżyć Cię do osiągnięcia sukcesu komercyjnego. Polega na skrupulatnej analizie grupy docelowej i dopasowaniu przekazu reklamowego do odpowiednio wyznaczonych grup. O tym, czym dokładnie jest mikrotargetowanie, jakie techniki wykorzystuje się do analizy osobowości internatów oraz jaki wpływ na sukces wyborczy Donalda Trumpa miało zatrudnienie firmy zajmującej się analizą danych, pisałem w poprzednim wpisie. Tym razem skupię się na praktyce i przedstawię przydatne wskazówki, które pomogą Ci osiągnąć cel marketingowy.

Mikrotargetowanie w mediach społecznościowych

Bez względu na to, czy dopiero zaczynasz działalność, czy chcesz poprawić wyniki sprzedaży, mikrotargetowanie będzie miało znaczący wpływ na zwiększenie zasięgu i poprawę widoczności Twojej witryny.

Precyzyjne określanie grupy docelowej być może wydaje Ci się skomplikowane, w rzeczywistości jednak może okazać się łatwe, a do tego ciekawe. Jeśli pieczołowicie dobierzesz grupę docelową, kierując się założeniem „mikro”, a do tego przekaz marketingowy dopasujesz tak, że trafi on w sedno potrzeb i zainteresowań odbiorców, może okazać się, że zgromadzisz wokół swojej witryny osoby, które utożsamiają się z Twoim przekazem i będą aktywnie uczestniczyły w budowaniu silnej społeczności.

W przypadku e-commerce mikrotargetowanie może być realizowane przy pomocy różnych digitalowcyh strategii, a jednym z najbardziej istotnych narzędzi są media społecznościowe.

Poniżej opisuję trzy istotne techniki wykorzystywane do mikrotargetowania, których możesz użyć w mediach społecznościowych.

-

Precyzyjne określanie grupy docelowej z wykorzystaniem wewnętrznych danych z mediów społecznościowych (np. z Facebooka).

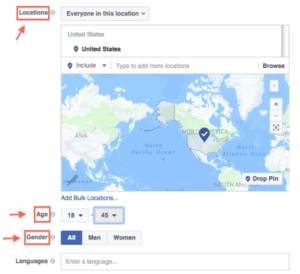

W tym wypadku możesz targetować kampanie reklamowe na kilka sposobów. Są nimi na przykład:

- wybieranie określonych przedziałów wiekowych osób, do których mają trafić reklamy,

- wybierając konkretne zainteresowania grupy docelowej,

- określając dane demograficzne.

Jeśli zdecydujesz się kierować swoje reklamy do mikro grup, takie segmentowanie odbiorców może Ci pomóc. Facebook będzie wyświetlał reklamy tylko użytkownikom, którzy spełniają określone przez Ciebie kryteria.

-

Czynnik emocjonalny

W biznesie e-commerce niezwykle istotne jest dopasowanie przekazów do odbiorców na poziomie emocjonalnym. Ważne, aby zawartość reklamy trafiała w sedno (można nawet powiedzieć: w czułe punkty) i poruszała te aspekty, które są istotne dla Twoich odbiorców. W związku z tym mikrotargetowanie odgrywa bardzo ważną rolę w określaniu grup docelowych za pośrednictwem social mediów.

-

Targetowanie na podstawie analizy zachowań użytkowników mediów społecznościowych

Platformy społecznościowe mogą dzielić użytkowników na grupy zgodnie z ich zachowaniami w sieci. Daje to możliwość kierowania ich na strony, które pasują do ich zainteresowań. Portale społecznościowe pozwalają Ci też wybrać niewielkie podgrupy (podzbiory), po to, aby identyfikować i dobierać odbiorców na poziomie mikro.

Skup się na opcjach, które są dostępne w konkretnych mediach społecznościowych, np. na danych demograficznych, zainteresowaniach oraz zachowaniach i rozwijaj je. Korzystaj ze zoptymalizowanej strategii mikrotargetowania i kieruj reklamy do mikro grup za pośrednictwem mediów społecznościowych.

Analiza predykcyjna i mikrotargetowanie krok po kroku

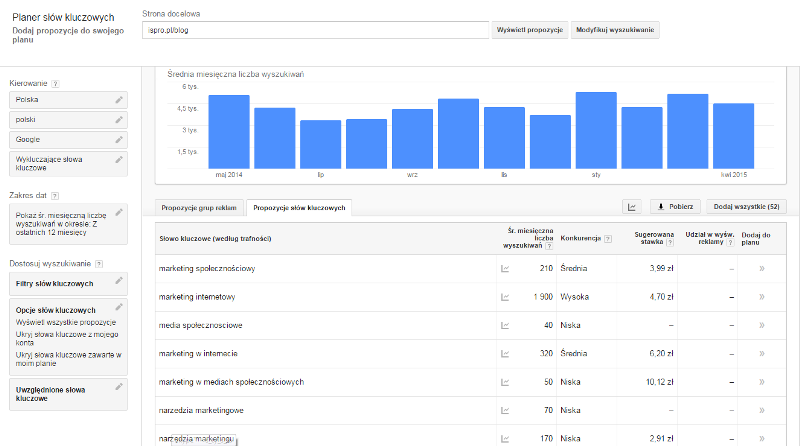

O analizie predykcyjnej możesz przeczytać we wspomnianym wcześniej artykule Mikrotargetowanie, sukces przedsiębiorstwa i wygrana Trupma w wyborach – jaki jest ich wspólny mianownik?. Dowiesz się z niego, jakie są jej założenia teoretyczne.

A teraz skupimy się na praktycznych aspektach łączenia analityki predykcyjnej i mikrotargetowania:

-

Tworzenie zbioru danych

Określ tak precyzyjnie, jak to możliwe, dla jakiej grupy chcesz uzyskać dane (mogą to być np. osoby, które zainicjowały transakcję, ale jej nie dokończyły) oraz jaki cel chcesz osiągnąć.

Zbiór danych możesz stworzyć na podstawie informacji dostępnych w Twoim serwisie, takich jak historia zamówień, odpowiedzi na pytania z ankiety czy dane demograficzne. Dane możesz również zakupić od wyspecjalizowanych firm, zajmujących się zbieraniem i analizą informacji o użytkownikach internetu.

-

Analiza osób, które znalazły się w danym zbiorze i znalezienie ich cech wspólnych

Jeśli dokładnie przeanalizujesz wspomnianą wcześniej grupę osób, będziesz mógł wskazać ich cechy wspólne. Pomoże Ci to w zbudowaniu modelu służącego do kierowania reklam do innych użytkowników – takich, którzy mają cechy, jak osoby znajdujące się w analizowanym zbiorze.

-

Tworzenie zmiennej zależnej

Zmienna zależna służy do segmentacji danych i ich podziału na grupy (grupy te będą analizowane w modelu predykcyjnym). Możesz w tym celu wykorzystać SQL, czyli język zapytań służący do tworzenia i modyfikowania baz danych oraz wskazywania („wyciągania”) konkretnych danych z baz.

-

Tworzenie modelu predykcyjnego, który pobiera zmienną zależną

Model predykcyjny pobiera stworzoną zmienną i porównuje ją z innymi zmiennymi w zbiorze danych. Inne zmienne, które mogą Ci się przydać to np. kraj zamieszkania, stan, kod pocztowy, płeć, stan cywilny etc.

-

Tworzenie modelu regresyjnego

Proces, który określa związki między zmienną zależną a innymi zmiennymi, podlegającymi analizie, nazywany jest modelem regresyjnym. W wyniku tego procesu otrzymujesz statystyczne korelacje dla każdej zmiennej. Pozwala on także określić wyniki dla całego modelu oraz wyniki dla poszczególnych zmiennych. Dzięki temu możesz wyeliminować wyniki z niskimi korelacjami do zmiennej docelowej.

-

Tworzenie powiększonej listy osób, które pasują do otrzymanych danych

Po wykonaniu wszystkich powyższych kroków, prawdopodobnie będziesz dysponować solidnym zbiorem danych demograficznych, konsumenckich czy innych istotnych informacji na temat użytkowników. Na tej podstawie będziesz mógł zidentyfikować więcej osób, które pasują do interesującej Cię grupy.

Jakie są zasady mikrotargetowania – przydatne wskazówki na koniec

W mikrotargetowaniu istotne jest przede wszystkim kierowanie swojego przekazu wyłącznie do osób, które wykazują zainteresowanie tematem oraz tworzenie przekazów, które pasują do stylu życia odbiorców czy ich statusu społecznego lub materialnego.

Wrażenie na odbiorcach można wywoływać na przykład poprzez używanie dialektów, profesjolektów czy socjolektów (czyli słów bądź wyrażeń wykorzystywanych przez określone grupy zawodowe czy społeczne), a także poprzez realizowanie pomysłów pasujących do ściśle określonych grup docelowych.

Ponadto ważne jest, aby wzbudzać ciekawość i aktywizować użytkowników. Jeśli trafisz w sedno i dobrze określisz mikro grupę, rozbudzisz jej ciekawość i zachęcisz do dalszych działań.

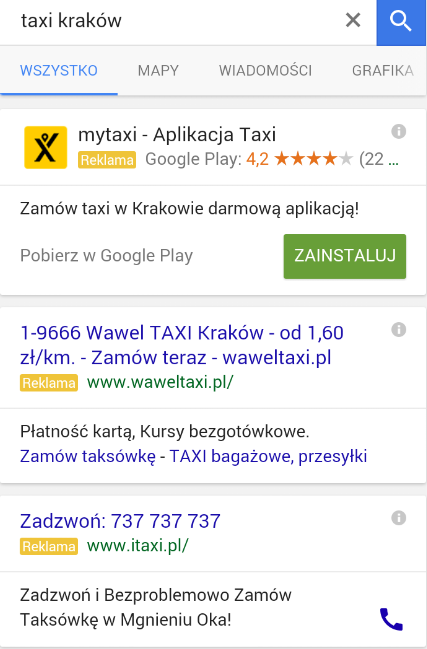

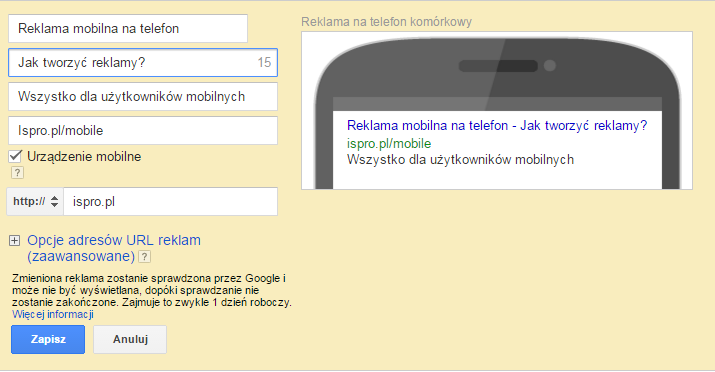

Nie zapomnij też o dopasowaniu formatów, które pasują do urządzeń najczęściej wybieranych przez grupę docelową. Nie bagatelizuj znaczenia urządzeń mobilnych. Pamiętaj, że coraz większa ilość Twoich klientów korzysta ze smartfonów częściej niż z komputerów i ma do nich dostęp niemalże 24 godziny na dobę.