Web mining, czyli sieć patrzy na Ciebie

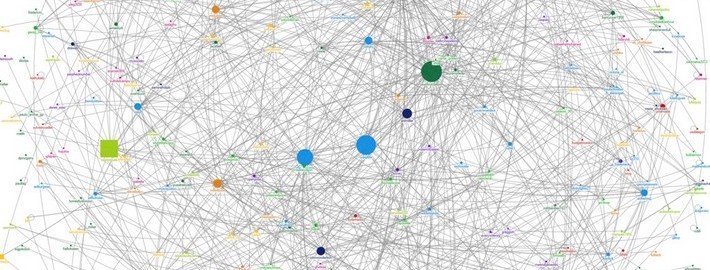

Sieć patrzy i próbuje Cię zrozumieć, żeby móc się dostosować do Twoich potrzeb, przede wszystkim zaś, by te potrzeby wykreować – tak w sporym uproszczeniu wyjaśnić można pojęcie web mining. Eksploracja danych w internecie to zjawisko związane z opisywanym już na blogu brakiem anonimowości w internecie, ale też z poruszaną niedawno kwestią coraz powszechniejszej automatyzacji. Data mining to zbiór technik automatycznego odkrywania nietrywialnych zależności, schematów, wzorców, reguł (ang. patterns) w zbiorach danych (ang. Knowledge Discovery in Databases, KDD) . Jednym z takich zbiorów jest internet, którego eksplorację nazywamy z angielskiego web mining lub web data mining.

Etapy modelu Cross-Industry Standard Process for Data Mining:

- Zrozumienie uwarunkowań biznesowych – na tym etapie kluczowe jest jasne sformułowanie celów i wymagań dotyczące projektu.

- Zrozumienie danych – zebranie danych i ich poznanie za pomocą eksploracyjnej analizy. Na tym etapie odkryte zostają pierwsze zależności, może też ocenić jakość danych.

- Przygotowanie danych – wykonanie przekształceń, czyszczenie danych, usunięcie wartości skrajnych.

- Modelowanie – wybór i zastosowanie odpowiednich technik modelujących, następnie zaś skalowanie parametrów modelu w celu optymalizacji wyników. Wyróżnia się trzy główne techniki modelowania: grupowanie, reguły asocjacyjne i klasyfikację.

- Ewaluacja – ocena modeli pod względem jakości i efektywności przed ich wdrożeniem. Na tym etapie konieczne jest ustalenie, czy model spełnia wszystkie założenia z pierwszego etapu.

- Wdrożenie – wykorzystanie modeli zgodnie z celami biznesowymi.

Kilka elementów analizy użytkowania sieci:

- Analiza kliknięć (ang. click stream analysis) – do jej zrozumienia konieczna jest znajomość pojęcia strumienia kliknięć. Jest on sekwencją odwiedzanych stron przez użytkownika podczas surfowania w sieci. Oprócz odsłon dane strumienia kliknięć obejmują pliki log, pliki cookies oraz inne dane używane podczas przesyłania stron internetowych z serwera do przeglądarki.

- Pliki log serwera – jeszcze przed rozpoczęciem analizy kliknięć niezbędne jest zapoznanie się z rodzajem dostępnych danych do tej analizy. Informacja dotycząca sposobów korzystania z sieci przyjmuje formę plików log serwera. Dla każdego żądania z przeglądarki do serwera generuje się automatycznie odpowiedź, której wynik jest zapisywany właśnie w ten sposób – przyjmuje formę rekordu zapisanego w pojedynczej linii, który jest dołączany do pliku tekstowego znajdującego się na serwerze.

- Rekord logu serwera EPA zawiera:

- Pole adresu IP hosta – zawiera adres internetowy IP hosta, który wysyła żądanie. Jeśli nazwa hosta znajduje się w serwerze DNS to ta nazwa jest dostępna.

- Pole data/czas – zawiera czas żądania.

- Pole żądanie HTTP – zawiera informację, którą przeglądarka zażądała od serwera. Zasadniczo pole to może być podzielone na cztery części: metoda HTTP, identyfikator zasobu (URL), nagłówek i protokół.

- Pole kodu odpowiedzi HTTP – trzycyfrowa odpowiedź z serwera na żądanie przeglądarki klienta. Oznacza status żądania, czyli powodzenie, niepowodzenie błąd i ewentualnie typ błędu.

- Pole wielkości transferu – wskazuje na rozmiar pliku w bajtach, wysyłanego przez serwer do przeglądarki klienta. Wartość ta jest uzupełniona tylko w przypadku pomyślnego zakończenia żądania (pole kodu odpowiedzi sugeruje powodzenie).

Innym sposobem na identyfikację użytkownika są ciasteczka, czyli opisywane już pliki cookies.

I kilka ważnych pytań …

Jakich danych potrzebujemy do przeprowadzenia analizy za pomocą modelu eksploracji danych?

Odpowiedzi na jakie pytania dostarcza analiza kliknięć?

Jakie są zadania przetwarzania danych z pliku log?

I najważniejsze: po co nam web mining?

- Sprzedaż internetowaEksploracja danych może pomóc sprzedawcom internetowym, poprzez dostarczanie im przydatnych i dokładnych trendów dotyczących zachowań nabywczej swoich klientów. Dzięki temu możliwe jest bardziej precyzyjne i skuteczne dotarcie do klienta z dedykowaną ofertą.

- Bankowość / KredytowanieEksploracja danych może pomóc instytucjom finansowym w obszarach takich jak raportowanie zdolności kredytowej oraz innych informacji kredytowych. Umożliwia oszacowanie poziomu ryzyka związanego z każdym kredytobiorcą.

- Egzekwowanie prawaEksploracja danych może pomóc w identyfikacji osób podejrzanych oraz przestępców na bazie ich przyzwyczajeń i innych wzorców zachowań.

- Kwestie bezpieczeństwaIle razy słyszeliście już o wycieku danych? No właśnie. Nawet takie giganty rynkowe jak Sony nie są bezpieczne.

- Nieetyczne wykorzystanie danychGwarancji na to, że nasze dane wykorzystane będą tylko w dobrym celu, nie uzyskamy nigdzie. Szantaż, dyskryminacja – wszystko się zdarzyć może. Co więcej – techniki zbierania i analizy danych nie są bezwzględnie skuteczne. Wszędzie może wkraść się błąd i użytkownicy mogą ponieść tego konsekwencje.

Dodaj komentarz

Chcesz się przyłączyć do dyskusji?Feel free to contribute!